HDR-Event Hamburg

Bei einem kleinen Event in Hamburg zeigte Matthias Bolliger die Technik und Möglichkeiten von HDR.

»High Dynamic Range (HDR) ist ein Verfahren, bei dem ein größerer Kontrastumfang im Vergleich zu Standard Dynamic Range (SDR) erreicht wird. Hierbei werden hellere und dunklere Bereiche des Bildes genauer dargestellt, was eine realistischere Wiedergabe von Farben und Helligkeiten ermöglicht« – das sagt zumindest ChatGPT, wenn man dieses KI-Tool danach fragt (— da steht im Lexikon von film-tv-video.de schon mehr drin).

Dieses Kratzen an der Oberfläche zeigt, dass es letztlich eben doch weitaus mehr braucht als einen Computer oder ein Handy und eine KI, um Dinge wirklich zu erklären und zu verstehen. Man muss sie — besonders im Fall von HDR — sehen und praxisnah erklärt bekommen.

Unter dieser Prämisse stellten der Kameraverleih Cine-Mobil, das Post-Haus Optical Art sowie die Film- und Theaterausstattung FTA Anfang Februar ein Event für Filmschaffende in Hamburg auf die Beine, um einerseits nach dem Corona-Loch quasi wieder »alle an einen Tisch« zu bekommen, sich auszutauschen und allen Interessierten der Branche HDR vor allem praktisch näher zu bringen.

Hierfür wurde Matthias Bolliger gewonnen, ein renommierter Kameramann, der etwa für Filme wie »Chiko«, »Blutzbrüdaz«, diverse »Tatorte« und die Serie »4Blocks« hinter der Kamera stand und schon mit zahlreichen Preisen ausgezeichnet wurde. Zudem gibt er sein praktisches Wissen auch als Dozent und Trainer weiter, was wiederum zum aktuellen Event führte.

In den Hallen von FTA hatte Bolliger bereits vor der Veranstaltung diverse Demoaufnahmen mit einer Arri Alexa 35 (Infos) gedreht. Das aufgebaute Set konnte beim Event live begutachtet werden, und man durfte selbst mit der Kamera HDR-Looks ausprobieren. Zusätzlich stand noch eine mobile Grading Suite von Optical Art zur Verfügung. Einiges an Anreiz also, sich auf den Weg in Hamburgs Westen zu machen.

Viele der Gäste hatten schon Berührungspunkte mit HDR, schließlich kann nahezu jede einigermaßen aktuelle Kamera irgendwie auch in HDR aufnehmen. Aber wie funktioniert HDR bei Film und Video, wie kann man weiter in die Tiefe dieses Schlagworts vordringen?

Basics

Im Fotografiebereich kennt man HDR schon lange. Hier hat man es zumindest bei unbewegten Motiven viel leichter – mehrere Fotos mit unterschiedlichen Belichtungen knipsen und diese dann zu einem extrem kontrastreichen Endprodukt zu stacken. Somit lassen sich besonders Schatten sowie Lichter als auch die Farbintensität optimieren, das Bild erhält einen höheren Dynamikumfang.

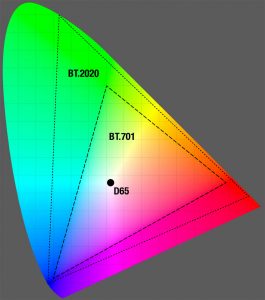

Bei Video sieht die Sache etwas anders aus. Voraussetzung für HDR ist ein möglichst hohes Farbsampling, und das mindestens in 10 Bit und 4:2:2. Wer seine Kamera dann auf HDR umstellt, wird sich plötzlich in einem neuen Farbraum wiederfinden – Rec.709 ist einfach viel zu klein für HDR. Und dieser neue Farbraum hört auf den Namen Rec.2020 oder auch BT.2020.

Die Kamera ist natürlich nur das eine Ende von HDR, man braucht also einen Sensor und eine Signalverarbeitung, die ein HDR-Signal erfassen, verarbeiten und speichern kann. Die andere Seite ist die Darstellung: Man braucht natürlich auch Displays, die es ermöglichen, HDR-Bilder darzustellen, sonst kommt ein Großteil des Aufwands und der Mühe, die man am vorderen Ende reinsteckt, am hinteren Ende der Kette nicht an.

Ein wichtiger Begriff, der bei HDR im Display-Bereich oft fällt, ist Nits. Dadurch wird die kurzzeitig maximale Leuchtdichte eines Displays gemessen. Je höher also die Anzahl der Nits, desto besser ist die Fähigkeit des Bildschirms, HDR-Inhalte mit einer größeren Helligkeitsspanne und höherem Kontrast darzustellen. Ein Nit entspricht einem Candela pro Quadratmeter, ist also eine Einheit zum Messen der Leuchtdichte.

Zwischen der Kamera und dem Display braucht man Signalformate, mit denen man die Inhalte vom einen Ende digital zum anderen Ende transportieren kann. Hierfür gibt es diverse HDR-Formate, die das ermöglichen. Mehrere Methoden und Hersteller buhlen im Markt darum, was das jeweils beste HDR-Format sei. Dabei werden jeweils unterschiedliche Technologien und Spezifikationen verwendet. Die gängigsten HDR-Formate im Überblick:

HDR10 ist ein offenes HDR-Format, das auf Blu-ray- und Streaming-Plattformen weit verbreitet ist. Es verwendet einen einheitlichen Kontrastumfang / einheitliche Farbpalette für alle Geräte und kann maximal 1.000 Nits darstellen.

HDR10+ ist eine Weiterentwicklung und geht bis 4.000 Nits.

Dolby Vision: Ein proprietäres HDR-Format, das eine höhere Auflösung und mit 12 Bit eine größere Farbtiefe als HDR10 bietet. Es kann geräte- und inhaltsspezifische Anpassungen vornehmen, um eine optimale Wiedergabe zu ermöglichen. Außerdem liegt die maximale Helligkeit bei 10.000 Nits.

HLG (Hybrid Log-Gamma) ist ein HDR-Format, das für die Übertragung von HDR-Inhalten über reguläre SDR-Übertragungskanäle entwickelt wurde. Es kann auf einer Vielzahl von Geräten wiedergegeben werden, einschließlich Fernsehern, Monitoren und Projektoren. Der große Vorteil bei HLG liegt darin, dass der Sender ein einzelnes Videosignal ausstrahlen kann, das dann je nach Endgerät automatisch in HDR oder SDR dargestellt wird, je nachdem, was das Gerät eben beherrscht.

Für eine optimale Wiedergabe sollte das Abspielgerät das gleiche HDR-Format unterstützen, das der Zulieferer genutzt hat. Sonst gibt es innerhalb der Kette Transkodierungen — und das kostet eigentlich immer Bildqualität.

Praxis

In der Filmtechnikgeschichte gab es ja immer wieder mal Innovationsschübe, die sich dann aber in der Praxis nicht auf breiter Basis durchsetzen konnten: Stereo-3D wurde letztlich drei Mal neu erfunden…

Die Frage bei Neuerungen ist also immer auch die, ob sie sich durchsetzen. Und anders als bei Stereo-3D sieht es mit HDR sehr gut aus — einfach schon aus dem Grund, weil man es mit bloßem Auge sehr deutlich sehen kann — und es Sinn ergibt.

So arbeitete Matthias Bolliger in seinem Vortrag neben den ganzen technischen Details und Workflows einen Aspekt heraus, an den viele gar nicht denken, wenn es um HDR geht: Die sinnvolle Verteilung der Helligkeitswerte und Nutzung des Headrooms. Natürlich kann man sein Bild knallig und poppig erscheinen lassen und das Signal nach oben und unten bis zum Maximum strecken. Das ist aber vielleicht gar nicht der wesentliche Vorteil von HDR…

Zur Verdeutlichung kann man eine Analogie verwenden und das Tonmastering in einer Timeline hernehmen: Wenn ich einen Horrorfilm schneide, möchte ich den Zuschauer natürlich durch laute Geräusche schocken. Daher pegelt man den ganzen Film — oder zumindest einige Passagen vor dem Schockereignis etwas niedriger, um dann nach oben noch etwas Raum für die akustischen Schockeffekte zu haben, ohne zu übersteuern. In der Praxis stellt der Zuschauer seinen Fernseher natürlich auf die heruntergeregelte Lautstärke ein. Kommen jetzt meine Audioeffekte, sind diese natürlich viel lauter und wirken besser.

Auf HDR übertragen, lassen wir beim Graden also auch noch etwas Headroom. Matthias Bolliger konnte das in seinem Vortrag sehr gut verdeutlichen: Eine Explosion und ein Blitz werden ja immer heller sein als reines Weiß in einem normalen Bild.

In der RGB Parade oder im Waveform-Monitor wurde beim Beispiel das Weiß nicht auf die 1.000 Nits Obergrenze des Displays gelegt, sondern darunter. Dadurch hat man dann noch Luft nach oben, um eben extrem leuchtende Dinge wie die angesprochene Explosion zum einen heller und zum anderen detailreicher darstellen zu können — weil nichts ausbrennt. Mit fortschreitender Technologie werden wir also bald im Wohnzimmer richtig geblendet werden, sollte es im Film mal blitzen…

Ein weiterer Vorteil von HDR liegt im Dynamikumfang, den die Lichtquellen im Bild gewinnen. In der Praxis bedeutet dies: mehr Details und vor allem mehr Dynamik in den Farben. Davon profitieren besonders LEDs, wenn sie etwa als sichtbare Leuchte im Bild verwendet werden.

Da das Set, mit dem Matthias Bolliger die Szenen gedreht hatte, noch vor Ort aufgebaut war, konnte man direkt selbst mit der Belichtung der Arri Alexa 35 spielen und das Ergebnis im HDR-Vorschaumonitor begutachten – der ist natürlich beim Dreh in HDR obligatorisch.

Zusätzlich hatte Optical Art eine mobile Grading Suite mitgebracht, und Louise Temmesfeld stand nach ihrem Vortrag zum Techtalk zur Verfügung. Ebenso Matthias Bolliger, mit dem man sich nochmals intensiv über Kamera und Workflow austauschen konnte.

Fazit

Das hat letztlich den Charme dieser Veranstaltung ausgemacht: In lockerem Umfeld fachsimpeln zu können, neue sowie alte Freundschaften zu pflegen und sich zudem auch noch fortzubilden. Für mich persönlich war die Veranstaltung jedenfalls Anreiz, HDR gegenüber noch offener zu sein, was die Verwendung in künftigen Projekten angeht.

Matthias Bolliger hat gut verdeutlicht, dass HDR weitaus mehr als knallige Farben kann. Auch hier kommt es natürlich immer drauf an, was man dreht. Profitieren dürften alle Produktionen davon, ob High- oder Lowkey im szenischen Bereich, realistische und grelle Explosionen bei Actionfilmen oder einfach die Schönheit unserer Natur mit all ihren Farben und Kontrasten, festgehalten in einer Dokumentation.