Bachelorarbeit »Luz•e«: eine stereoskopische 3D-Animation

Stefan Müller setzte im Rahmen seiner Bachelorarbeit eine stereoskopische 3D-Animation um: Er erstellte in Autodesk Maya 2009 und Adobe After Effects CS4, den Kurzfilm »Luz•e«. In dieser gekürzten Version des schriftlichen Teils seiner Bachelorarbeit berichtet er, welche Gestaltungsmittel die Stereoskopie bietet, mit welchen Herausforderungen er konfrontiert war und wie er das Endprodukt — ein Digital Cinema Package — mit Hilfe von EasyDCP ins digitale Kino brachte.

Im Rahmen seiner Bachelorarbeit an der Hochschule der Medien in Stuttgart realisierte Stefan Müller als Student der audiovisuellen Medien eine stereoskopische 3D-Animation mit dem Titel »Luz•e«. Die Werkzeuge seiner Wahl waren dabei Autodesk Maya 2009 und Adobe After Effects CS4. Um am Ende der Produktion ein Digital Cinema Package zu erstellen, griff Müller auf EasyDCP zurück, ein vom Fraunhofer-Institut entwickeltes Software-Tool. So brachte Stefan Müller die Animation auf die große Leinwand im hochschuleigenen digitalen Kino. Für film-tv-video.de berichtet Müller in der Rubrik »Zu schade für die Schublade« von seinem Vorgehen bei der Umsetzung. Zu sehen ist der Clip hier: http://www.youtube.com/watch?v=0YCvVz41XVM, um den Stereo-3D-Effekte zu sehen, brauchen Sie eine Rot-Cyan-Brille. Um die Besonderheiten dieses Clips zu verstehen, empfiehlt sich die Lektüre des folgenden Texts. Umgekehrt stellt der Clip einige der beschriebenen Sachverhalte anschaulich dar.

Neue Gestaltungsmittel in der Stereoskopie

Mit der Einführung jeder neuen Technik eröffnen sich auch stets neue künstlerische Möglichkeiten. So verhält es sich auch mit der Stereoskopie. Im folgenden sind diese Gestaltungsmittel beschrieben und soweit nötig auch die technischen Grundlagen dafür.

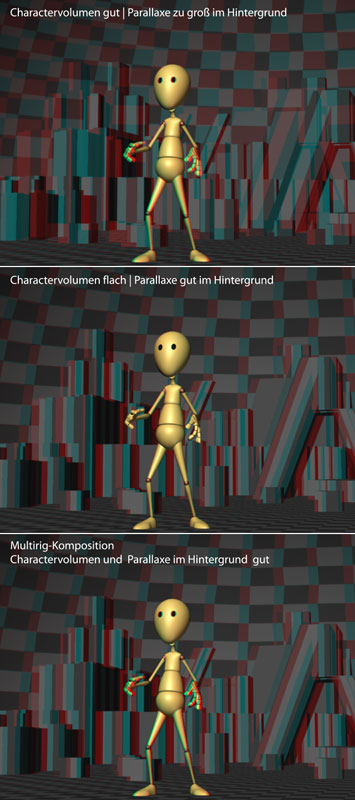

Auch bei der Stereoskopie beginnt die Gestaltung bereits mit der Wahl des richtigen Objektivs. Generell lässt sich sagen, dass Teleobjektive für stereoskopische Aufnahmen eher ungeeignet sind. Objekte verlieren ihr Volumen und flachen ab, das gilt auch die gesamte Tiefenstaffelung in einer Szene. Weitwinkelobjektive sind hier in der Regel die bessere Wahl, können die räumliche Darstellung aber auch überstrecken. Betrachtet man in diesem Zusammenhang einzelne Objekte, spricht man von der Objekttiefe oder Rundheit, die neben der Brennweite auch vom »Basisabstand« (Abstand zwischen den beiden Kameras) beeinflusst wird. Im Normalfall soll das Volumen der Hauptfiguren in einer Szene korrekt dargestellt werden. Das kann jedoch dazu führen, dass die horizontale Verschiebung einander zugeordneter Bildpunkte (Parallaxe) etwa im Hintergrund zu groß wird und der Zuschauer Probleme bei der Betrachtung bekommt. In diesem Fall muss man entweder zugunsten des Hintergrundes die Stereoparameter nachjustieren und damit den Objekten im Vordergrund Volumen nehmen, oder man benutzt ein Multi-Camera-Rig, das mehrere Stereo-Kameras enthält, die jeweils für bestimmte Objekte optimiert sind und deren Bilder dann im Compositing zusammengeführt werden. So kann sowohl die Hauptfigur als auch der Hintergrund in einer Szene korrekt dargestellt werden.

Darüber hinaus bietet die Stereoskopie noch weitere Möglichkeiten, die Wirkung von Objekten zu beeinflussen. Ist der Basisabstand im Verhältnis zum Objekt etwa sehr groß, wirkt es modellhaft und klein. Hierbei spricht man von Liliputismus. Ist jedoch der Basisabstand verhältnismäßig klein, kann ein Objekt größer wirken, als es eigentlich ist. Dieser sogenannte Gigantismus und auch der Liliputismus lassen sich somit einsetzen, um die Größenwirkung von Objekten zu steuern. Eine Ameise kann auf diesem Weg sehr groß wirken und umgekehrt ein Elefant sehr klein. Die Stereoskopie bietet also hervorragende Möglichkeiten, Größenverhältnisse darzustellen zu betonen und falls gewünscht, zu manipulieren. Man kann hierbei immer den Vergleich zum natürlichen Sehen ziehen.

Der Scheinfenstereffekt

Die Betrachtung stereoskopischer Bilder entspricht nicht ganz dem natürlichen Sehen, und daraus resultieren auch einige Probleme. Das wichtigste zu berücksichtigende Phänomen ist der Scheinfenstereffekt. Der Blick auf die (3D)-Leinwand ähnelt dem Blick durch ein Fenster. Probleme entstehen dann, wenn Objekte vor die Leinwand treten und dabei ebenfalls an der Bildkante abgeschnitten werden. Das »Scheinfenster« verdeckt sozusagen ein Objekt, das stereoskopisch gesehen aber vor und nicht hinter dem Fenster liegt. Dieser Zustand kann vom menschlichen Gehirn nicht richtig interpretiert werden und der Raumeindruck zerfällt.

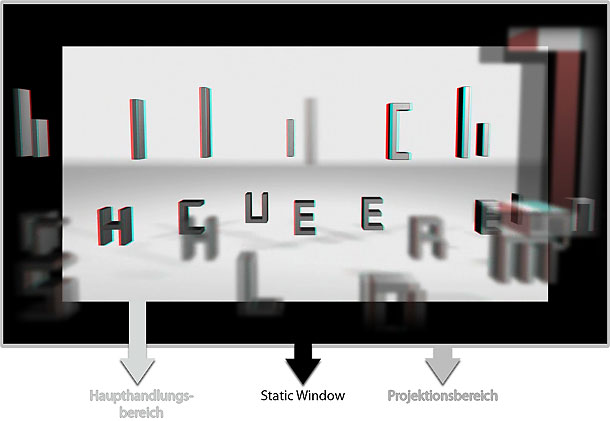

Es gibt aber inzwischen Lösungen für dieses Problem. Die erste, einfache Lösung besteht darin, dass Objekte die vor der Leinwand dargestellt werden, einfach nicht den Rand berühren dürfen. Eine weitere, weitaus anspruchsvollere Lösung ist das »Floating Window«. Hier wird vor das eigentliche Scheinfenster ein virtueller schwarzer Rahmen positioniert, der sich stereoskopisch gesehen vor kritischen Objekten befindet und diese somit auch verdecken kann. In der Umsetzung ist das Floating Window nichts anderes, als eine Maske an den Seitenrändern der stereoskopischen Halbbilder, die je nach Szene angepasst wird. Alternativ zum Floating Window kann man auch den eigentlichen Bildbereich verkleinern und einen schwarzen Rahmen um das Bild legen, der dann verdeckt werden kann, wenn ein Objekt den verkleinerten Bildbereich verlässt. Dieses »Static Window« habe ich in meinem Kurzfilm »Luz•e« verwendet, um die Grenze zwischen der Welt auf, beziehungsweise in der Leinwand und dem Publikum darzustellen. Der Film diente im Rahmen meiner Bachelorarbeit als Grundlage und Experimentierwiese, um die Stereoskopie nicht nur theoretisch zu behandeln, sondern auch praktisch zu begreifen.

Die Erstellung einer stereoskopischen Computeranimation am Beispiel von »Luz•e«

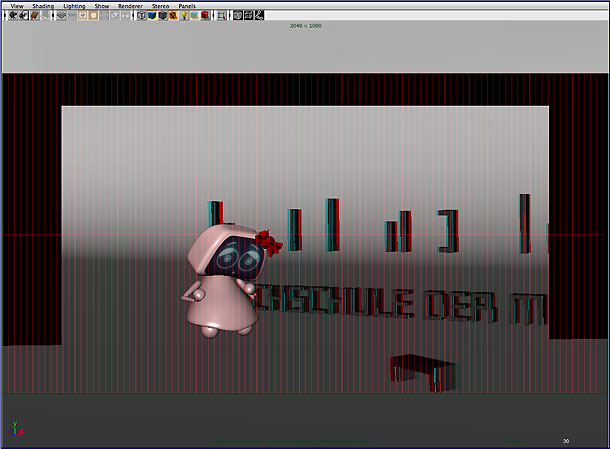

»Luz•e« entstand komplett in Maya 2009, das ab dieser Version Stereoskopie als neues Feature beinhaltet. Da keine 3D-Displays während der Produktion verfügbar waren, nutzte ich ausschließlich die Anaglyphenansicht (Rot/Cyan-Brille).

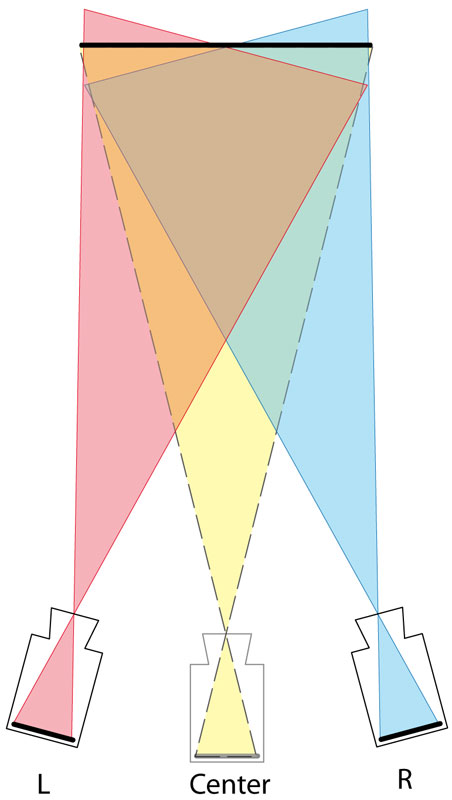

Bei der Produktion stereoskopischer Bilder ist die Wahl des richtigen Kamera-Rigs von entscheidender Bedeutung. Maya bietet eine Stereokamera an, die man in den Modi »Off«, »Parallel«, »Converged« und »Off-axis« nutzen kann. Die rechte und linke Stereokamera übernehmen hierbei die meisten Parameter für die im Setup übergeordnete Center-Kamera. Da nicht alle Parameter mit der Center-Kamera verlinkt sind, muss man gegebenenfalls selbst Hand anlegen. Insgesamt sind die Kameras so miteinander verknüpft, dass die Stereo-Attribute der Center-Cam-Node »Interaxial Separation« (also der Basisabstand), »Zero Parallax« (Entfernung, bei der sich die Kameraachsen schneiden) und einige mehr, in Transform- und Rotate-Werte der linken und rechten Kamera übersetzt werden. Im Off-Mode liegen die rechte, linke sowie die Center-Kamera deckungsgleich übereinander und erzeugen somit keinen Stereoeffekt. Im Parallel-Mode liegen die Kameras, wie der Name schon vermuten lässt, parallel zueinander. Diese Einstellung ist für Szenen geeignet, die sich sehr weit in die Tiefe erstrecken, was dem menschlichen Blick in die Ferne entspricht.

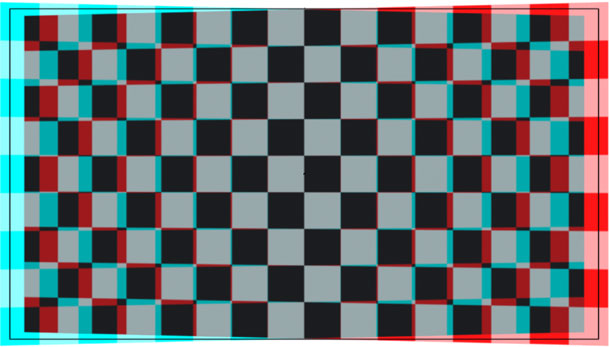

Die dritte Kamera-Variante heißt »Converged«. Hier drehen sich die linke und rechte Kamera zueinander und bilden den Konvergenzwinkel. Hier spielt zum ersten Mal das »Zero Parallax«-Attribut eine wichtige Rolle, da dieses den Konvergenzwinkel steuert. Der Konvergenz-Mode ist für Objekte geeignet, die sich nahe an der Kamera befinden. Zu beachten ist aber, dass durch die Drehung der Kameras zueinander Keystone-Effekte auftreten, durch die das Stereobild vor allem an den Rändern stark beeinträchtigt wird. Sollen nur einzelne Objekte in der Mitte des Bildes dargestellt werden, ist das aber kein Problem.

Völlig problemfrei ist im Vergleich dazu die Verwendung der Stereo-Kamera im »Off-Axis«-Mode, auch als HIT-Mode bekannt. Hier stehen die Kameras wieder parallel zu einander und anstatt die Kameras zu drehen, wird der virtuelle Bildsensor der Kameras nach außen verschoben. Dadurch erhält man Konvergenz ohne Keystone-Effekte befürchten zu müssen. Dieser Modus ist für reine CG-Aufgaben bestens geeignet, da er ein absolut sauberes und komfortables Stereobild erzeugt.Für „Luz•e“ fiel meine Entscheidung daher auch auf diese Variante.

Die Stereokamera in Maya stellt allerdings nur ein rudimentäres Grundgerüst eines Stereo-Rigs dar. Ich modifizierte es daher in einigen Aspekten, um das Handling etwas intuitiver gestalten zu können. So wurde etwa das bereits erwähnte »Static Window« in das Kamera-Rig eingebunden und ein Raster über die Ansicht gelegt, um die maximale Parallaxe einzuhalten.

Das Rendern stereoskopischer Bilder unterscheidet sich kaum vom herkömmlichen Workflow. Man muss lediglich die Stereokamera (»Stereo-Pair«) als Render-Kamera auswählen und beide Kameras werden nacheinander gerendert. Um Renderzeit zu sparen bietet es sich an dieser Stelle an, einen Renderer mit Multi-Kamera-Rendering zu benutzten. So kann man die Renderzeit merkbar senken. Zudem nutzte ich die Möglichkeit, eine eigene Ordnerstruktur mit Hilfe von Tokens in den Maya-Render-Einstellungen festzulegen. So wurde für jede Szene ein neuer Ordner angelegt, der die Unterordner für die verschiedenen Render-Layer enthielt. Erst in der letzten Ordnerebene wurde dann nach rechter und linker Kamera aufgeteilt. Zudem achtete ich auf eine klare Benennung der Files, um nicht die Übersicht bei dieser Datenflut zu verlieren.

Schnitt und Compositing

Da zur Produktion von »Luz•e« noch keine Stereo-Lösungen für Schnitt und Compositing verfügbar waren, kamen hierfür Final Cut und After Effects zum Einsatz. Für den Rohschnitt verwendete ich Playblasts aus Maya, die ich schon anaglyph ausgab um die Stereo-3D-Wirkung im Schnitt zu kontrollieren und gegebenenfalls Kameraeinstellungen anzupassen. Für den Schnitt ist es wichtig, dass die Stereo-Settings der einzelnen Szenen nicht zu stark von einander abweichen und man den Augen Zeit gibt, sich an eine neue 3D-Umgebung zu gewöhnen. Wer in einem Stereo-3D Film schnelle Schnitte haben möchte, muss demzufolge die Stereo-3D-Wirkung im Film minimieren. Für die Planung der 3D-Wirkung ist hierbei ein »Depth-Script« sehr hilfreich, das die räumliche Wirkung mit der emotionalen Intensität im Film verknüpft. Hierbei wird für jede Szene festgelegt, wie groß der Stereo-3D-Effekt ausfallen soll.

Als letztendlich der Rohschnitt stand, und die gerenderten Daten vorlagen, galt für mich das Prinzip: »Links vor rechts!« Da die schon erwähnten Stereolösungen fehlten, erledigte ich den Schnitt und das Compositing erst komplett für das linke Auge. Um dann schließlich für das rechte Auge ein identisches Endergebnis zu bekommen, kopierte ich die Projekt-Files der linken Seite und ersetzte das verwendete Footage durch das der rechten.

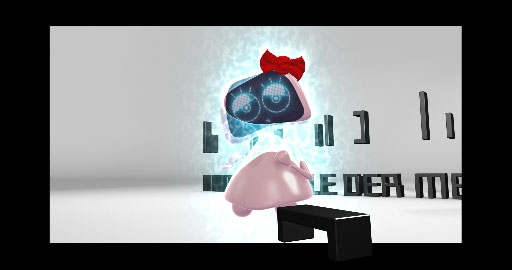

In den meisten Szenen funktionierte das sehr gut und einfach. Es gab aber im Compositing einzelne Fälle, die besonders behandelt werden mussten, da hier in After Effects noch zusätzliche Eingriffe gemacht wurden. So etwa in der ersten Szene, in der Buchstaben aus dem Zuschauerraum von hinten in die Leinwand fliegen. Da der Stereo-3D-Effekt in einer solchen Szene, die auch noch den Startpunkt des Films darstellt, sehr unvermittelt kommt, brauchte ich hierfür eine Lösung, die trotzdem ein angenehmes Stereobild ermöglichte. Ich ahmte schließlich das natürliche Sehen nach und ließ Objekte, die zu nah an den Zuschauer kamen, als unscharfe Doppelbilder verschwimmen. Obwohl diese Lösung teilweise auf eine stereoskopische Parallaxe verzichtet, funktioniert es in der Gesamtheit mit anderen Tiefenfaktoren und in der Kürze der Animation hervorragend.

Ein weiterer Spezialfall sind Szenen, in denen ein Kraftfeld erscheinen sollte, das ich in After Effects kreierte. Hier fiel mir besonders auf, dass viele 3D-Effekte stereoskopisch betrachtet, trotzdem ziemlich flach aussehen, da sie eine räumliche Perspektive lediglich vortäuschen. Schließlich konnte ich aber trotzdem noch ein glaubhaftes Kraftfeld basteln, das auch im richtigen 3D funktioniert.

Neben den Dingen, die in After Effects stereoskopisch nicht funktionieren, bietet das Programm aber auch gute Möglichkeiten eine stereoskopische Parallaxe zu erzeugen und damit eine Dreidimensionalität im Bild zu erreichen. Das funktioniert besonders gut mit typografischen Elementen. Hat man zwei identische Kompositionen (eine für das rechte und eine für das linke Auge) kann man durch eine horizontale Verschiebung einzelner Objekte in einer der beiden Kompositionen festlegen, ob und wie weit sie vor oder hinter der Leinwand erscheinen sollen. Arbeitet man dazu noch mit Überlagerungen und Transparenzen, gewinnt die Komposition zusätzlich an Räumlichkeit. Diese und eine andere Methode wandte ich auch im Abspann des Films an. Hier benutzte ich außerdem noch den »Corner Pin«-Effekt. Ich wendete ihn auf den Rolltext an, der à la »Star Wars« steil nach hinten weg laufen sollte. Ich verschob also die oberen Ecke des Corner Pins um wenige Pixel nach links und rechts und zumindest stereoskopisch gesehen, wanderte die Schrift weiter nach hinten, um so weiter sie im Bild nach oben kam. Die perspektivische Verzerrung erfolgte dann zusätzlich auf klassischem Wege.

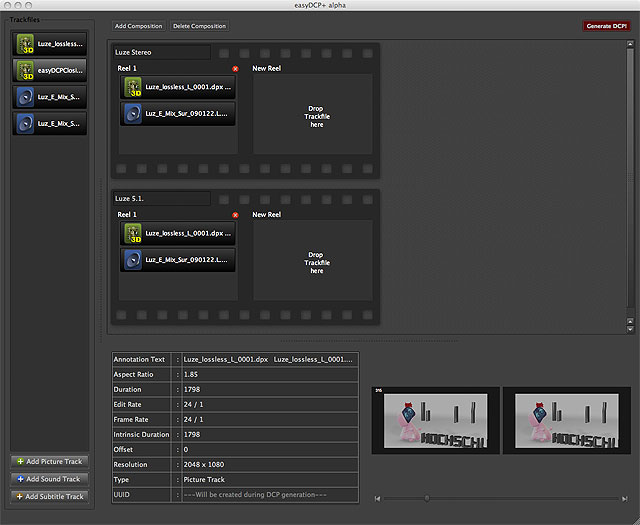

Nachdem schließlich der linke und rechte Film fertig waren, mussten diese noch in ein DCP (Digital Cinema Package) gepackt werden, da der Film von einem

Digital Cinema Package (DCP)

Nachdem in den letzten Jahren die digitale Technik Einzug in die Filmindustrie gehalten hat, sahen 2005 sieben große Filmstudios die Notwendigkeit, einheitliche Spezifikationen für digitales Kino festzulegen. Diese Studios waren: Disney, Fox, Metro-Goldwyn-Mayer (MGM), Paramount Pictures, Sony Picture Entertainment, Universal Studios und Warner Bros. Studios. Sie bildeten die Digital Cinema Initiative, LLC (DCI) mit der Überzeugung, dass ein festgelegter Standard allen Parteien in der Filmindustrie, von den Filmemachern bis hin zum Kinobetreiber, zugute kommt. Sie erkannten, dass die Einführung des digitalen Kinos (D-Cinema) nur funktionieren kann, wenn industrieweit die gleichen Standards gelten, womit Kompatibilität und eine hohe Qualität im gesamten System garantiert werden könnte. Es wurde die Digital Cinema System Specification aufgestellt, welche das Mastering, die Distribution und die Vorführung von D-Cinema-Inhalten definiert. Die Grundkomponenten der DCI-Spezifikationen sind: Digital Cinema Distribution Master (DCDM), Kompression, Packaging, Transport, Theater System, Projection und Security. Diese gelten sowohl für 2D- als auch für 3D-Inhalte.

Um die speziellen Anforderungen für stereoskopisches D-Cinema festzuhalten, wurde 2007 zusätzlich eine Erweiterung der DCI-Spezifikationen veröffentlicht: das Stereoscopic Digital Cinema Addendum, wonach bei stereoskopischen Inhalten linkes und rechtes Bild in genau dieser Reihenfolge mit einer Frequenz von 48 Hz wiedergegeben werden. Des weiteren gibt es eine maximale Auflösung von 2K, da die begrenzte Datenrate von 250 Mbps von für stereoskopisches 4K nicht ausreicht. Ein wichtiger Punkt wird in den DCI-Specs unter dem Punkt Packaging geregelt. Hier wird der Aufbau eines DCP beschrieben.

Grundsätzlich muss ein DCP folgende Bedingungen erfüllen: Öffentlicher Standard, interoperabel, skalierbar, Unterstützung grundlegender geschäftsrelevanter Funktionen, Sicherheit, erweiterbar, lesbare Metadaten und Identifikation. Um diese Voraussetzungen zu erfüllen, wurde für das DCP eine hierarchische Struktur entwickelt. Es ist unterteilt in einzelne Reels, denen wiederum durch eine Composition Playlist so genannte Trackfiles für Bild, Ton und Untertitel zugeordnet werden. Zudem gibt es noch eine Packing List, in der alle Komponenten des DCP erfasst sind.

Zusätzliche Informationen in der Composition Playlist sorgen zudem für die framegenaue Synchronität zwischen den einzelnen Bild-, Ton-, und Untertitelspuren. Dieses System erlaubt es, Trackfiles verschiedenen Reels zuzuordnen um etwa verschiedene Sprachversionen und Untertitel-Kombinationen bei gleichbleibendem Bild-Trackfile zu realisieren.

Mit dem Wissen um den Aufbau eines DCP stellt sich schnell die Frage, ob man nicht selbst mit einem üblichen Heim-PC ein DCP von Hand erstellen kann. Die Antwort lautet prinzipiell »ja«, wenn auch Aufwand und Nutzen in fragwürdigem Verhältnis stehen. Mithilfe verschiedener Open Source-Tools, C++-Bibliotheken, Geduld und den nötigen Programmierkenntnissen, lassen sich die nötigen Kodierungs- und Formatierungsaufgaben bewältigen. Die zahlreichen Arbeitsschritte bergen aber soviel Fehlerpotential, dass es besser ist, auf ein Programm zurückzugreifen, dass diese vielen Schritte automatisch erledigt.

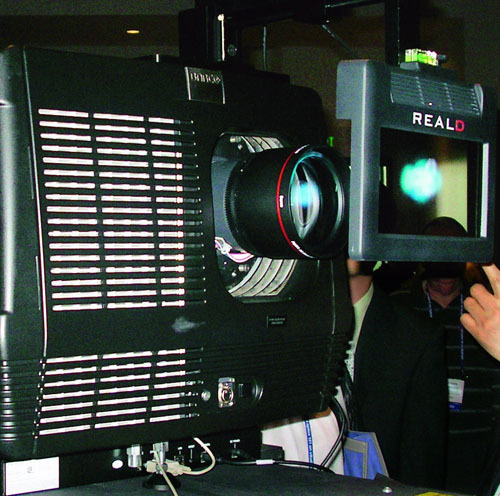

Ich nutzte an dieser Stelle EasyDCP, das vom Fraunhofer Institut IIS in Erlangen entwickelt wurde. Dieses Tool erlaubt die kinderleichte Erstellung eines DCPs in wenigen Arbeitsschritten per Drag and Drop. Der Film als DCP kann dann von jedem Stereo-3D-fähigen D-Cinema-System wiedergegeben werden. Hierfür sind ein Server, ein Projektor mit Stereo-3D-Modul und eine Soundanlage notwendig.

Das DCP wird direkt auf den Server geladen. Dieser entpackt und enschlüsselt die Daten und gibt die Bilddaten an den Projektor weiter. Dieser projiziert nun alternierend jedes Frame des linken und rechten Auges dreimal pro Sekunde (Triple Flash) und erhöht damit die Bildwechselfrequenz zwischen links und rechts von 48 auf 144 Hz. Ausgestattet mit einem 3D-Brillensystem entsteht so ein flimmerfreies Stereo-3D-Bild auf der Leinwand.

Im Fall meines Filmes »Luz•e« war es ein aktives Shutterbrillen-System, bei dem LC-Panels in der Brille durch ein Infrarotsynchronsignal des Projektors jeweils ein Brillenglas verdunkeln. Das Gefühl ist kaum zu beschreiben, wenn man sein Werk zum ersten Mal auf dem Medium und in den Dimensionen sieht, für die man es produziert hat. Da der Stereo-3D-Effekt erst auf einer großen Leinwand voll zum tragen kommt, ist dieser Moment in der Stereoskopie von besonderer Bedeutung.

Kontakt zum Verfasser

Stefan Müller: sm060@hdm-stuttgart.de

Weitere Infos

Die komplette Bachelorarbeit von Stefan Müller steht am Ende dieser Seite als PDF zum Download bereit. Ergänzend zu diesem Artikel hat Stefan Müller Informationen zu den Zukunftschancen und möglichen Entwicklungen bei der Stereoskopie im Kino zusammengefasst.

Bei film-tv-video.de finden sie zahlreiche weitere Artikel zum Thema Stereo-3D:

Einen Artikel mit technischen Grundlagen zum Thema Stereo-3D-Realaufnahmen finden Sie hier.

Infos über aktuell verfügbare Stereo-3D-Rigs finden Sie hier. Ein Videoreport über das Stereo-3D-Rig von P+S Technik von der NAB2008 steht hier bereit, ein Update bietet der IBC-Videoreport (HQ-Video).

Einen Messekommentar zum Thema Stereo-3D können Sie hier nachlesen, einen älteren finden Sie hier.

Einen Videoreport von der IBC2008 zum Thema Live-Stereo-3D können sie hier sehen.

Ein Gespräch mit Matt Cowen, Chief Scientific Officer des kanadischen Unternehmens Real D, steht hier bereit.

Wie die Games-Welt mit Stereo-3D ins Kino kommen will, erklärt ein Interview zu diesem Thema.

Infos zur Projektion fasst ein weiterer Artikel zusammen, ergänzende Infos hierzu bietet eine weitere Meldung.

Welche Chancen Quantel dem Thema Stereo-3D einräumt, können sie in einem Videoreport sehen.

Downloads zum Artikel: